Wat je als bedrijf moet weten en hoe je je kan voorbereiden

De Europese Unie heeft met de AI Act een grote stap gezet in het reguleren van kunstmatige intelligentie (AI). Dit baanbrekende kader biedt duidelijke richtlijnen voor de ontwikkeling en toepassing van AI-systemen, gericht op het beschermen van fundamentele rechten, veiligheid en privacy. Met de AI Act wil de EU het vertrouwen in AI vergroten en innovatie stimuleren door een balans te vinden tussen regelgeving en ruimte voor ontwikkeling.

Hieronder bespreken we de belangrijkste aspecten van de AI Act, de tijdlijn voor implementatie en wat dit betekent voor bedrijven.

Waarom is de AI Act belangrijk?

De snelle groei van AI-technologie heeft geleid tot ingrijpende veranderingen in sectoren zoals gezondheidszorg, transport en HR. Tegelijkertijd brengt deze technologie ook risico’s met zich mee, zoals privacy schendingen, discriminatie en gebrek aan transparantie. De AI Act biedt een juridisch kader om deze risico’s aan te pakken en ethische AI-toepassingen te bevorderen.

Belangrijkste kenmerken van de AI Act

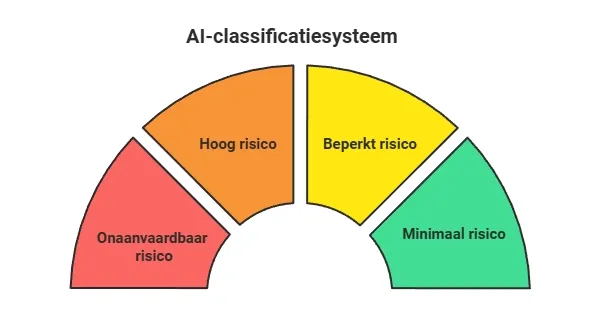

De kern van de AI Act is een classificatiesysteem dat AI-toepassingen opdeelt in vier risicocategorieën:

- Onaanvaardbaar risico

AI-systemen die fundamentele rechten bedreigen, zoals sociale scoring of manipulatieve technieken, worden volledig verboden. Voorbeeld: AI-gebaseerde technieken die kinderen manipuleren via online advertenties. - Hoog risico

Toepassingen in kritieke domeinen zoals gezondheidszorg, transport, biometrische identificatie en HR vallen onder strenge regelgeving. Eisen voor bedrijven zijn onder andere:- Transparantie over hoe het systeem werkt.

- Externe audits en documentatieplicht.

- Menselijk toezicht tijdens gebruik.

- Beperkt risico

AI-systemen zoals chatbots vereisen transparantie. Gebruikers moeten bijvoorbeeld weten dat ze met een AI communiceren. - Minimaal risico

AI-systemen zoals spamfilters en videogames worden nauwelijks gereguleerd.

Wat betekent dit voor bedrijven?

De AI Act heeft gevolgen voor bedrijven die AI-tools gebruiken of ontwikkelen. Hier zijn enkele praktische stappen die bedrijven kunnen nemen:

Voor bedrijven die AI-tools gebruiken

- Beoordeel risico’s:

Analyseer welke AI-systemen worden gebruikt en bepaal in welke risicocategorie deze vallen. Dit helpt om te begrijpen welke verplichtingen gelden. - Zorg voor transparantie:

Communiceer duidelijk naar klanten, werknemers en stakeholders over de werking van AI-systemen, zoals de herkomst van data en algoritmische beslissingen. - Implementeer governance en naleving:

Ontwikkel interne richtlijnen en train werknemers om AI-tools correct en ethisch te gebruiken. - Bereid je voor op audits:

Documenteer hoe AI-systemen worden gebruikt en voldoe aan de regelgeving. Dit is vooral belangrijk voor hoog-risico AI-tools.

Voor providers van AI-tools

- Ontwikkel systemen volgens regelgeving:

Zorg dat AI-systemen transparant zijn, menselijke controle mogelijk maken en geen fundamentele rechten schenden. - Voer risico- en impactanalyses uit:

Voor hoog-risico AI-systemen is een conformiteitsbeoordeling verplicht. Dit moet worden vastgelegd en gedeeld met toezichthouders. - Waarborg transparantie bij levering:

Lever uitgebreide documentatie aan klanten, inclusief informatie over functionaliteiten, risico’s en naleving van regelgeving. - Onderhoud een AI-register:

Registreer hoog-risico AI-systemen in de door de EU ingestelde AI-database. Dit bevordert traceerbaarheid en toezicht.

De Tijdlijn van de Europese AI Act

- 1 augustus 2024: De officiële start

Vanaf deze datum treedt de AI Act officieel in werking. Dit markeert het begin van een nieuw tijdperk voor AI-regelgeving in Europa. - 2 februari 2025: Verbodsbepalingen en kennisplicht

AI-systemen met een “onaanvaardbaar risico” worden verboden. Deze systemen moeten volledig van de Europese markt worden verwijderd. De zogeheten AI-kennisplicht gaat in. Dit houdt in dat bedrijven verplicht zijn om specifieke informatie over hun AI-systemen te verstrekken, zoals gegevens over de werking en risico’s. - 1 augustus 2025: Nieuwe eisen voor AI-modellen

Voor algemene AI-modellen gelden vanaf deze datum nieuwe eisen. Dit betekent dat ontwikkelaars moeten voldoen aan strengere voorwaarden rondom transparantie, veiligheid en betrouwbaarheid. Toezichthoudende autoriteiten moeten zijn aangewezen om toezicht te houden op de naleving van deze wetgeving. - 2 augustus 2026: Hoogrisico- en transparantieverplichtingen

De meeste artikelen van de AI Act worden vanaf deze datum van kracht. Voor hoog-risico AI-systemen (zoals in de gezondheidszorg of infrastructuur) gelden strenge verplichtingen. Deze systemen moeten worden beoordeeld op veiligheid en ethische risico’s. AI-systemen met een beperkt risico krijgen transparantieverplichtingen, zoals duidelijke communicatie over het gebruik van AI. - 1 augustus 2027: Productverplichtingen voor hoog-risico AI

Vanaf deze datum gelden de verplichtingen voor hoog-risico AI-systemen die in producten worden gebruikt. Denk hierbij aan AI-integratie in medische apparaten of industriële toepassingen. - 1 augustus 2030: Overheidsgebruik van bestaande AI-systemen

Voor AI-systemen die al vóór de inwerkingtreding van de wet door overheidsorganisaties werden gebruikt, gelden vanaf deze datum specifieke verplichtingen. Dit biedt tijd voor een overgangsperiode, zodat overheidsinstellingen hun systemen kunnen aanpassen aan de nieuwe regelgeving.

Conclusie

De AI Act is een van de meest ingrijpende regelgeving voor kunstmatige intelligentie tot nu toe. Met een duidelijke tijdlijn, strenge eisen en hoge boetes dwingt het bedrijven om verantwoordelijkheid te nemen voor de impact van hun AI-systemen. Tegelijkertijd biedt de wet kansen om vertrouwen in ethische AI-oplossingen te vergroten. De synergie tussen de AI Act en GDPR versterkt de focus op gegevensbescherming en privacy.

Voor bedrijven is nu het moment om actie te ondernemen. Door te investeren in transparantie, risicomanagement en privacy vriendelijke technologieën, kunnen ze niet alleen aan de regelgeving voldoen, maar ook een voortrekkersrol spelen in de transformatie naar een veiligere en verantwoorde AI-toekomst.